К марту 2026 года технологический мир уперся в парадокс: вычислительная мощность моделей растет по экспоненте, но реальная продуктивность бизнеса застряла под «стеклянным потолком» регламентов. Пока корпорации вливают миллионы в серверные мощности, сотрудники уходят в «теневой ИИ», используя локальные инструменты в обход фильтров безопасности. На этом фоне статьи a16z и Harvard Business Review выглядят как диагноз эпохе: они фиксируют разрыв между жестким контролем организаций и личной эффективностью профи. Чтобы сократить эту дистанцию, специалисты все чаще выбирают умных помощников в обучении, которые переводят теорию в практику быстрее неповоротливых корпоративных курсов. Если хотите сразу перевести тему в практику, посмотрите ChefBot для меню и рецептов.

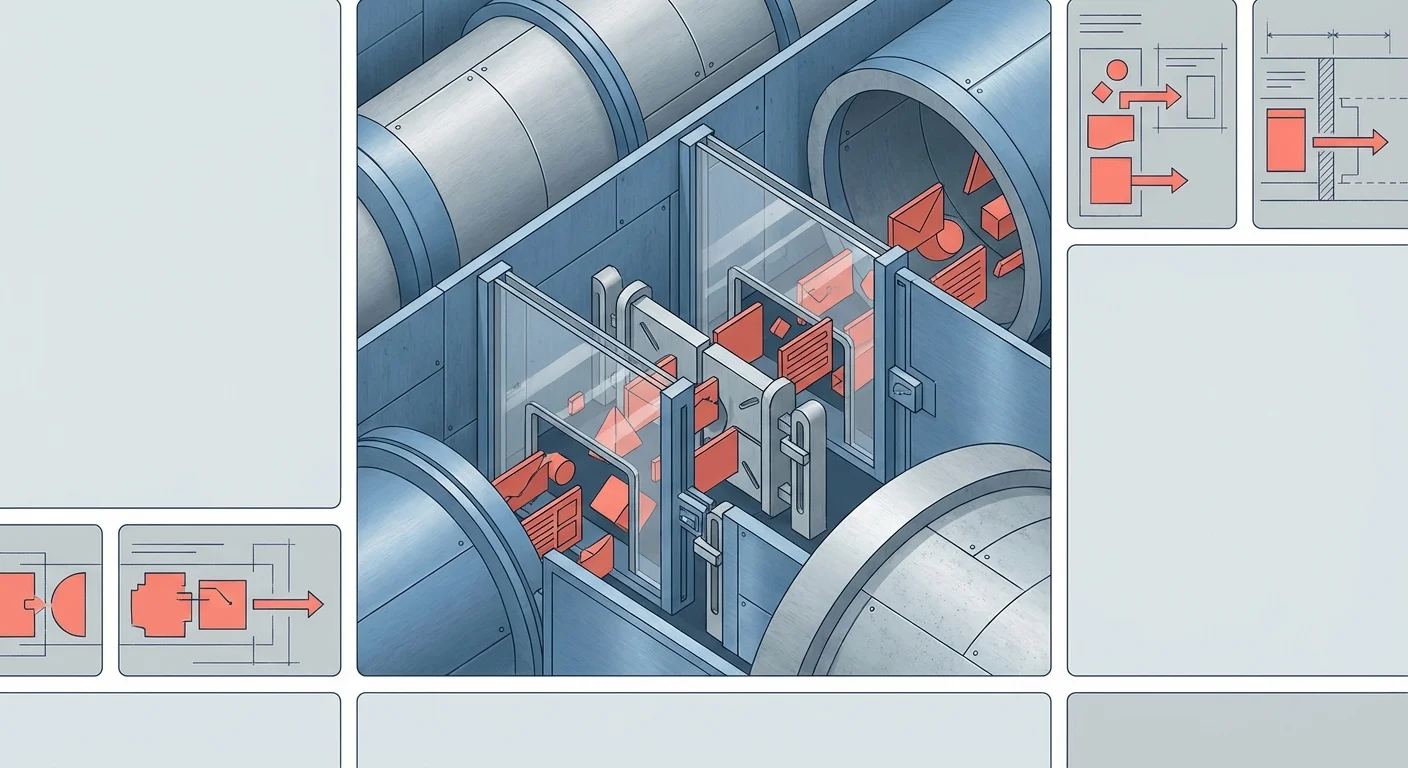

Сегодня вектор развития нейросетей определяет борьба за контроль. С одной стороны — стремление компаний к централизации ради безопасности и этических рамок. С другой — опыт практиков, которые видят, как корпоративные фильтры «стерилизуют» ИИ, убивая его пользу. Этот конфликт интересов тормозит цифровую трансформацию: технологический потенциал моделей уже давно опережает готовность бизнес-процессов к их внедрению. В итоге компании рискуют остаться с дорогими, но бесполезными инструментами, пока рынок уходит вперед.

- Институциональный ИИ: жесткая централизация, цензура вывода и приоритет безопасности над скоростью.

- Индивидуальный ИИ: открытые модели на персональных устройствах, полный контроль над весами и данными.

- К марту 2026 года технологический мир уперся в парадокс: вычислительная мощность моделей растет по экспоненте…

- Сегодня вектор развития нейросетей определяет борьба за контроль.

- Внутри статьи разобран вопрос: Институциональный ИИ: архитектура контроля и её издержки.

Институциональный ИИ: архитектура контроля и её издержки

В 2026 году институциональный ИИ превратился в закрытую крепость. Его главная задача — минимизировать риски: от утечек данных до репутационных скандалов. Но на практике эта осторожность становится барьером. Когда корпоративная нейросеть блокирует анализ рыночного отчета из-за «чувствительного контента», сотрудник просто теряет время. Безопасность здесь покупается ценой паралича рабочих процессов.

Аналитики a16z уверены: владение весами моделей станет фундаментом цифровой свободы. В офисах это право узурпировано ИТ-департаментами. Банки блокируют внешние LLM, навязывая сотрудникам слабые внутренние аналоги. Возникает абсурдная ситуация: штатный юрист часами разгребает рутину в «безопасной» системе, пока его конкурент-фрилансер за секунды прогоняет документы через локальный ИИ, не передавая ни одного байта в облако.

Результат предсказуем — тотальное недоверие персонала. Сотрудники чувствуют надзор за каждым промптом и сознательно ограничивают креативность. К 2026 году институциональный ИИ рискует стать слишком неповоротливым и неоправданно дорогим. Зависимость от проприетарных вендоров лишает компании гибкости: они становятся заложниками политики обновлений и цензуры одного поставщика.

Финансовый сектор ощущает этот барьер острее других. Пока внутренние системы вязнут в согласованиях, частные пользователи внедряют персональных финансовых ассистентов для мгновенной оценки рисков. Индивидуальный ИИ позволяет одиночкам конкурировать с агентствами, используя инструменты, которые в крупных корпорациях официально запрещены.

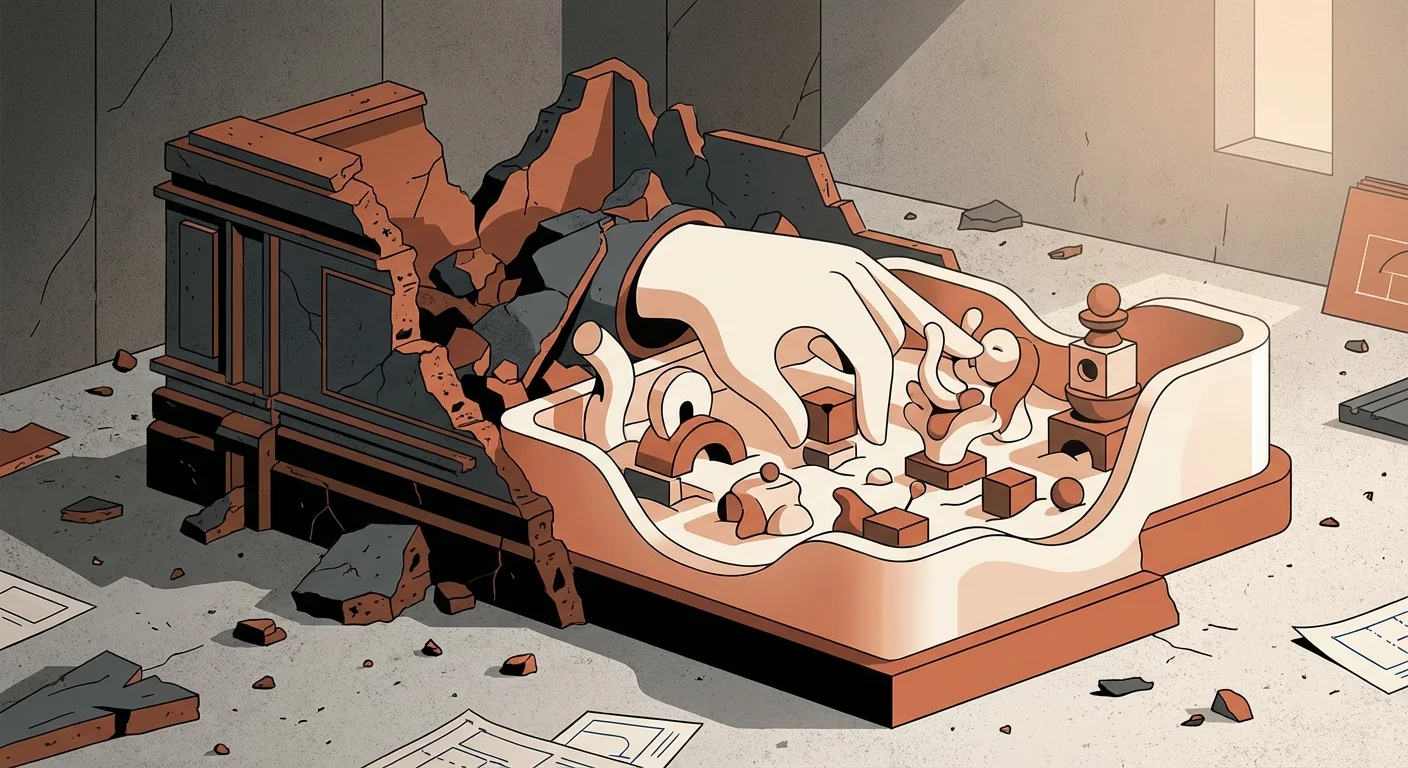

Проблема последней мили: почему ИИ-трансформация буксует

Harvard Business Review (HBR) вскрывает другую проблему — «последнюю милю». Это пропасть между выводами нейросети и конкретным действием в бизнесе. К марту 2026 года компании внедрили LLM, но оставили структуру процессов неизменной. Это напоминает заводы начала XX века, где электромоторы ставили на места паровых двигателей, не меняя логику производства.

Согласно данным HBR, 90% усилий в ИИ-проектах тратится не на обучение моделей, а на борьбу с инерцией. Нужно менять привычки людей, перекраивать интерфейсы и связывать ИИ с древним софтом. Часто стоимость такой интеграции в разы превышает цену самой модели. Без изменения культурного кода ИИ остается лишь дорогой игрушкой в руках топ-менеджмента.

Сценарий из практики: Завод внедрил ИИ-диагностику с точностью 99%. Но рабочие игнорируют прогнозы: мобильный интерфейс требует 15 кликов для оформления заявки. Нейросеть работает вхолостую, а станки продолжают ломаться из-за неудобного дизайна.

Успех трансформации зависит от того, насколько бесшовным будет путь от идеи ИИ до её исполнения. Пока разработчики гонятся за точностью, пользователи страдают от логистического ада. Врач может получить идеальную расшифровку анализов от ассистента, но потратит час на ручной перенос данных между несовместимыми базами. Интерфейс сегодня важнее, чем количество параметров в модели.

Для глубокого погружения в тему стоит изучить анализ трансформации бизнеса в 2026 году. Проблема последней мили часто игнорируется руководством, которое ждет мгновенной прибыли от покупки лицензий. Но эффективность ИИ измеряется не мощностью серверов, а скоростью изменения человеческих привычек.

Индивидуальный ИИ: локальные модели и суверенитет данных

В противовес корпоративным гигантам расцветает культура индивидуального ИИ. В 2026 году локальные нейросети справляются с большинством профзадач без подключения к сети. Это возвращает пользователю контроль: вы сами решаете, как дообучать модель и кому показывать результаты. Суверенитет данных становится главным преимуществом независимых специалистов.

Персональные агенты легко подстраиваются под сленг и специфику конкретного мастера. Дизайнер создает концепты на своем ноутбуке, не опасаясь, что его идеи уйдут в обучающую выборку корпораций. Программист пишет код с помощью агента, знающего его авторский стиль, что делает разработку консистентной. Подробнее о таких инструментах можно узнать в разделе решений для экспертов.

Данные на личных устройствах — самый ценный актив для дообучения. Это меняет динамику рынка труда: сотрудники все чаще используют личный ИИ в обход запретов. Маркетолог выбирает локальную модель для создания дерзкой кампании, потому что институциональный ИИ выдает лишь «безопасный» и пресный контент.

Но у свободы есть цена. Локальные модели чаще галлюцинируют из-за оптимизации под домашнее железо. Кроме того, хаос инструментов внутри одной фирмы мешает обмену данными. Если у каждого сотрудника своя «карманная» нейросеть, удержать единый стандарт качества в крупном проекте становится почти невозможно.

Перестройка управления: от контроля к фасилитации

Разрыв между личным и корпоративным ИИ заставляет компании менять политику. Вместо тотальных запретов бизнес начинает создавать «песочницы» — безопасные зоны для тестирования индивидуальных агентов. Это единственный способ легализовать «теневой ИИ». Актуальные тренды этой трансформации собраны в ленте новостей технологий.

Роль менеджера среднего звена смещается от контроля к фасилитации. Теперь его задача — наладить эффективный симбиоз человека и алгоритма. Обучение промпт-инжинирингу становится важнее закупки нового софта. Компании осознают: безграмотность сотрудников в работе с моделями обходится дороже, чем любые подписки.

Появляется новый класс ПО — мосты между закрытыми базами данных и персональными агентами. Это позволяет соблюсти баланс: секреты фирмы остаются внутри периметра, но обрабатываются удобными для пользователя инструментами. Гибридные модели управления станут стандартом для тех, кто хочет выжить в технологической гонке.

Автоматизация рутины требует пересмотра должностных инструкций. Если ИИ забирает 80% операционки, роль человека должна быть переосмыслена. Отсутствие ответов на эти вопросы — еще одна грань проблемы последней мили. Многие организации застыли в неопределенности, что подтверждают исследования в материале о реальных результатах внедрения ИИ.

Риски, этика и юридическая ответственность

Свобода индивидуального ИИ ставит острые вопросы. Кто отвечает за ошибку локальной модели в рабочем контракте? Юрист, разработчик открытого кода или компания, допустившая использование стороннего софта? Четких юридических ответов пока нет, и это создает «серую зону» ответственности.

Проблема «черного ящика» усугубляется, когда у каждого сотрудника этот ящик свой. Как доверять результату, если процесс его получения скрыт? Эти опасения заставляют службы безопасности занимать жесткую оборону, что лишь усиливает конфликт с продуктивными кадрами, стремящимися к эффективности.

# Проверка целостности локальной модели перед интеграцией в контур

check_model_integrity --weights ./local_llama_v4 --policy corporate_safety_2026.json

# Результат: отклонение в 12% от эталонных ответов безопасностиКиберугрозы тоже эволюционируют. Персональный агент с доступом к рабочему столу — идеальная точка входа для атак. Вопрос этики и безопасности ИИ перестает быть философским, превращаясь в чисто техническую задачу по защите периметра. Можно ли гарантировать честность модели, которую каждый настраивает под себя?

Решится ли проблема последней мили без долгой ломки психологии? Вряд ли. Логистические компании буксуют не из-за плохих алгоритмов, а из-за сопротивления водителей, не доверяющих «цифровым суфлерам». ИИ-трансформация рискует стать финансовым пузырем, если бизнес не научится внедрять технологии на уровне каждого рабочего места. Для полной картины рекомендуем полный гид по ИИ-революции.

Если хотите углубиться дальше на Dinkin, откройте ChefBot для меню и рецептов, FinGuru для бюджета и расчётов и PsyFriend для эмоциональной поддержки. Эти материалы логично продолжают тему статьи и дают следующий практический шаг.

Если хотите углубиться дальше на Dinkin, откройте EduHelper для учебных разборов и ленту свежих новостей Dinkin. Эти материалы логично продолжают тему статьи и дают следующий практический шаг.

FAQ

Что такое «проблема последней мили» в контексте ИИ?

Это разрыв между мощностью нейросети и её реальным применением. Проблема включает неудобные интерфейсы, сопротивление персонала и сложность встраивания выводов ИИ в ежедневные бизнес-задачи.

В чем главное преимущество индивидуального ИИ перед институциональным?

Это суверенитет. Вы владеете весами модели, запускаете её локально без цензуры и уверены, что ваши данные не используются для обучения чужих систем или слежки.

Почему корпорации так жестко контролируют использование ИИ?

Главные причины — защита данных, юридические риски и этические нормы. Институциональный ИИ проектируется так, чтобы исключить утечки и галлюцинации, даже если это снижает общую скорость работы.

Как индивидуальный ИИ влияет на рынок фриланса?

Он уравнивает правила игры. Фрилансер с мощной локальной моделью может работать быстрее целого агентства, не скованного корпоративными фильтрами и бюрократией.

Может ли локальная нейросеть полностью заменить облачную LLM?

К 2026 году локальные модели закрывают большинство задач: от кодинга до анализа текстов. Однако для работы с гигантскими массивами данных или сверхсложных вычислений облачные системы всё еще незаменимы.

Глоссарий

| Термин | Описание |

|---|---|

| Веса модели | Параметры нейросети, определяющие её «знания». Владение весами дает полный контроль над поведением ИИ. |

| Институциональный ИИ | Системы, развернутые внутри организаций с жестким контролем доступа и безопасности. |

| Последняя миля | Финальный этап внедрения, где технология сталкивается с человеческим фактором и реальными процессами. |

| Локальная модель | Нейросеть, работающая на железе пользователя без необходимости отправлять данные на внешние серверы. |

| Теневой ИИ | Использование личных нейросетевых инструментов для работы в обход официальных ИТ-политик компании. |