Рынок искусственного интеллекта тонет в информационном шуме. Отличить реальный технологический сдвиг от маркетингового хайпа становится всё сложнее. Журналисты авторитетного MIT Technology Review проанализировали индустрию и выделили 10 направлений, которые определяют будущее AI. Их главный вывод: фокус окончательно сместился с самих базовых моделей на их физическое применение. Раньше бизнес интересовало, какую картинку или текст выдаст алгоритм. Теперь важно, как встроить этот алгоритм в реальный мир. И пока генеративные сервисы вроде CreatorAI меняют работу с цифровым контентом, настоящая революция готовится за пределами экранов.

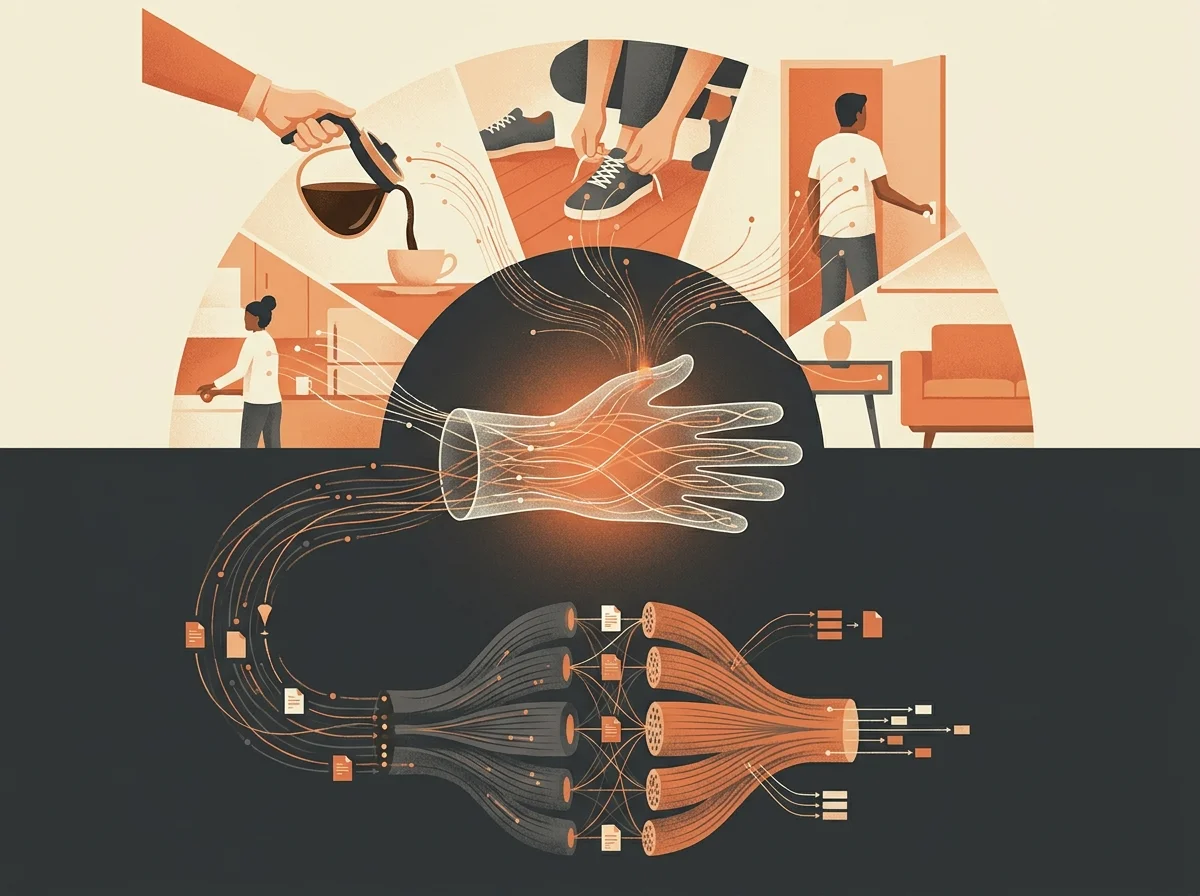

Самый неочевидный тренд года — массовый сбор данных о человеческой моторике. Разработчики гуманоидных роботов начали маниакально записывать телеметрию наших действий. Логика та же, что и у больших языковых моделей. Текстовые нейросети поумнели, «проглотив» огромные массивы информации из интернета. Теперь робототехнике нужен сопоставимый объем данных, но о физике: как человек берет кружку, открывает дверь или собирает деталь на станке. Главный вызов для AI сегодня — преодолеть пропасть между умным кодом и суровой физической реальностью.

- Рынок искусственного интеллекта тонет в информационном шуме.

- Самый неочевидный тренд года — массовый сбор данных о человеческой моторике.

- Конец эпохи симуляций и новая гонка за данными.

Конец эпохи симуляций и новая гонка за данными

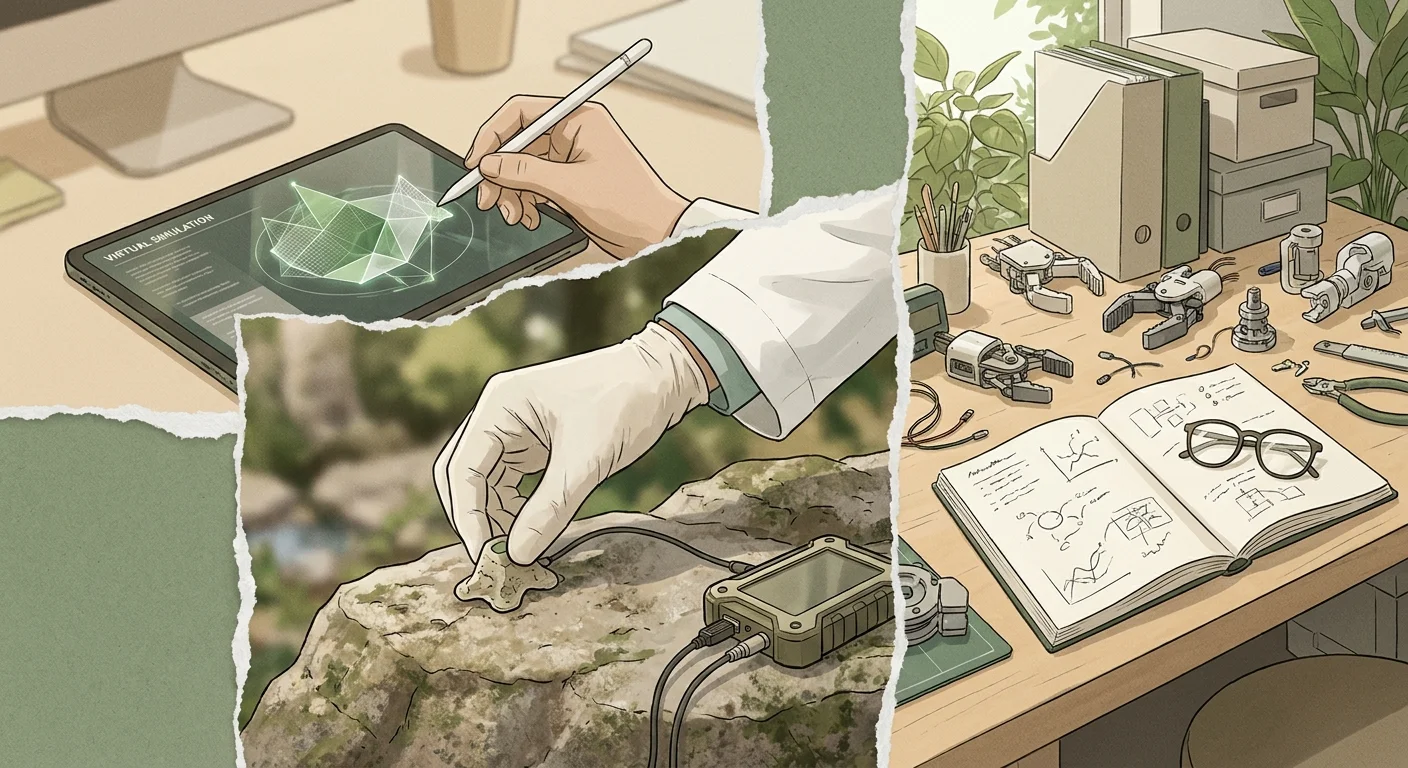

Проблема в том, что физический опыт нельзя просто скачать из сети. Его приходится кропотливо собирать вручную. Раньше инженеры пытались схитрить и обучали роботов в виртуальных симуляциях. На бумаге всё выглядело идеально: алгоритмы, написанные в средах вроде CodeGenius, прогоняли миллионы раз в безопасной «песочнице». Но на практике симуляции провалились. Они слишком примитивно воспроизводят свойства нашего мира.

Математически просчитать силу трения, упругость материалов, вес объектов и случайные сквозняки почти невозможно. Из-за этого робот, который идеально выполнял задачи в симуляции, падал на ровном месте в реальной лаборатории. Обучать машину только в виртуальности — всё равно что учиться водить фуру по видеоигре. Инженерам пришлось выйти из стерильных кабинетов «в поле».

Чтобы собрать эту уникальную телеметрию, в ход идет всё: продвинутые VR-тренажеры, тяжелые экзоскелеты, системы удаленного управления. На фоне инвестиционного бума в робототехнику это превращается в новую гонку вооружений. Индустрия понимает: рынок заберет тот, у кого будет самая большая и качественная база человеческих движений.

Выход в реальный контур: промышленность и наука

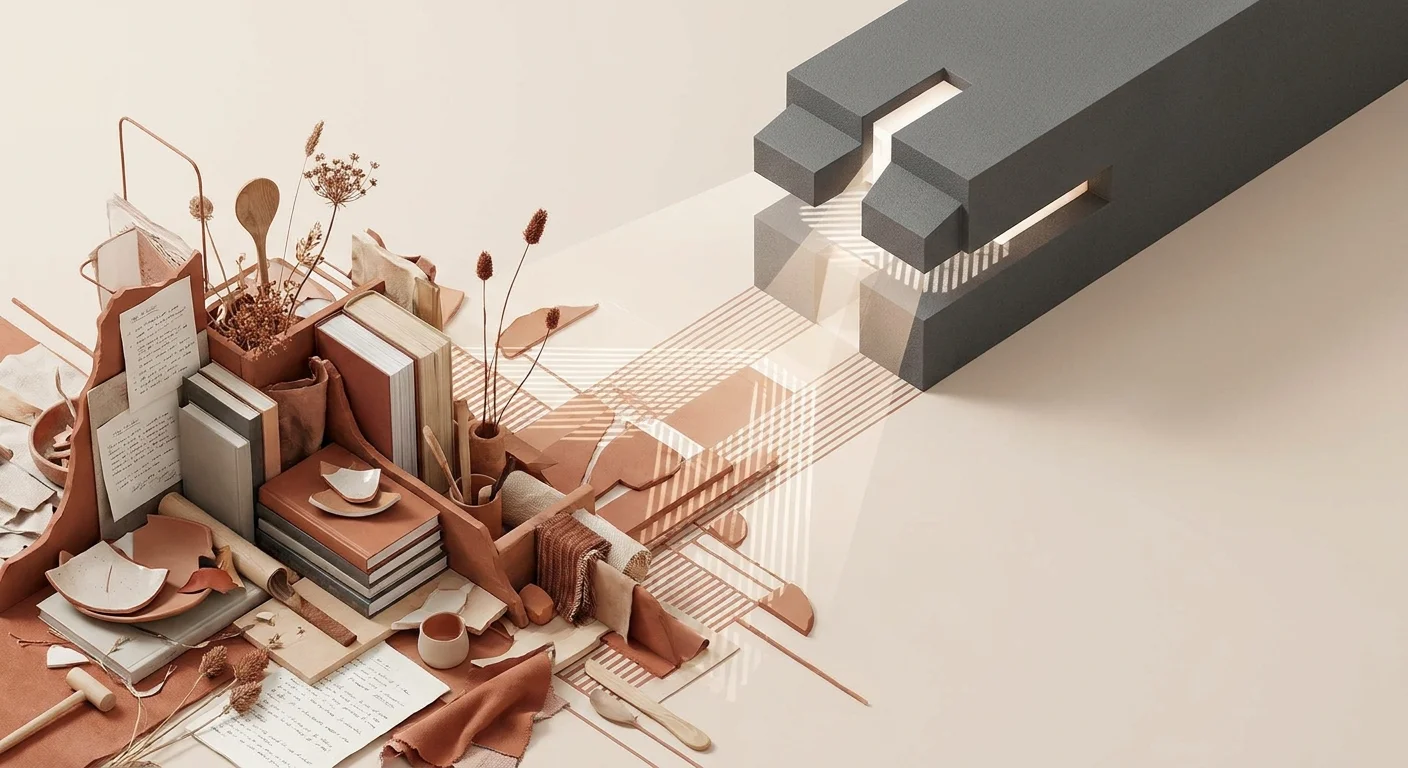

Аналитики MIT Technology Review делят тренды на три блока: эволюция самих технологий, их выход в физический мир и последствия этого масштабирования. «Выход в реальный контур» означает, что AI пускают в большую науку и на критически важные производства. Успех алгоритма больше не измеряется красивой демкой на презентации. Теперь важно, как он оптимизирует работу тяжелой промышленности.

Как это выглядит на практике, обсуждали 23 апреля на совместной сессии Госкорпорации «Росатом» и НИЯУ МИФИ. Тема — прикладной ИИ в атомной отрасли. Ректор МИФИ Владимир Шевченко отметил важную вещь: нейросети перестали быть модой, став реальным инструментом работы с информацией. Тот же «Росатом» активно внедряет алгоритмы в производственные процессы и научные изыскания. Цель прагматична — кардинально снизить издержки и обеспечить технологический суверенитет страны.

Но чтобы внедрять умные системы в новые бизнесы, нужна глубокая аналитика. Оценить финансовую отдачу от таких инноваций помогают корпоративные инструменты уровня FinGuru. При этом меняются требования к людям. Бурное развитие ИИ требует перестройки вузов: нужны новые специальности, современные образовательные программы и совершенно другие компетенции у выпускников.

Архитектура контроля: как работают «Guardrails»

Третий блок трендов — последствия. Чем умнее становятся алгоритмы, тем сильнее на них давят общество и хакеры. Возможности нейросетей стремительно растут, а государства формируют жесткий запрос на их контроль. Любую мощную технологию можно использовать во вред, и правительства пытаются успеть за этими вызовами.

Недавно замглавы Минцифры РФ Александр Шойтов прямо заявил о необходимости ограничений для искусственного интеллекта. Логика понятна: алгоритм — не гражданин, у него нет прав, зато есть огромный потенциал для массовой генерации дипфейков и опасного контента. Государство обязано от этого защищать. В инженерной среде механизмы такой защиты давно известны как «Guardrails» (в профессиональном сленге — «горды» или «ограждения»).

Технически гарды делятся на входные и выходные. Входные фильтры блокируют вредные запросы пользователя. Например, они спасают от промт-инъекций — атак, когда хакер хитрым текстом заставляет ИИ обойти запреты и выдать системные данные. Выходные фильтры проверяют ответы самой модели. Нейросеть работает на вероятностях и может выдать правдоподобный бред («галлюцинацию») или нарушить закон даже в ответ на безобидный вопрос. Задача гарда — убить такой текст до того, как он появится на экране. Настройка этих фильтров становится приоритетом, и платформы вроде EduHelper уже выступают важным звеном в подготовке кадров новой формации.

Экономика новых данных и этические барьеры

Индустрия прошла стадию слепого восхищения. Вопрос «что ИИ умеет?» сменился сложной дискуссией «как удержать его под контролем?». Теперь разработчикам приходится встраивать безопасность в архитектуру по умолчанию, с первого дня проектирования. Надежность умной системы стала такой же важной метрикой, как ее скорость. От инженера теперь требуют не только чистого кода, но и глубокого понимания этики.

Но здесь кроется серьезный риск. Гарды — не панацея от сложных, целенаправленных атак. К тому же возникает проблема цензуры: кто именно решает, какой ответ считать «неэтичным» или «неправильным»? Грань между безопасностью и «отуплением» модели очень тонка. Есть реальное опасение, что слишком жесткие рамки просто заморозят инновации в AI.

В гуманоидной робототехнике свои слепые зоны. Экономическая модель сбора физических данных пока не доказана. Компании сжигают колоссальные бюджеты на запись движений, но хватит ли этого, чтобы робот стал по-настоящему полезным в быту или на заводе? Юридическая база тоже туманна: кому по закону принадлежат права на оцифрованную моторику опытного токаря? Насколько вообще этично записывать движения живых сотрудников, чтобы обучить машины, которые завтра придут им на замену? Понимание того, как собираются и защищаются эти данные, становится ключевым фактором для оценки реального прогресса всей индустрии.

Если хотите углубиться дальше на Dinkin, откройте ленту свежих новостей Dinkin. Эти материалы логично продолжают тему статьи и дают следующий практический шаг.

FAQ

Какие ключевые направления выделяет MIT Technology Review?

Аналитики делят тренды на три блока: эволюция самих технологий (включая новые подходы к сбору данных), выход AI в реальный физический мир (внедрение в науку и тяжелую промышленность) и последствия масштабирования (рост кибератак, давление общества и необходимость государственного регулирования).

Почему разработчики роботов отказываются от виртуальных симуляций?

Обучение в симуляциях провалилось на практике. Виртуальная среда слишком примитивно воспроизводит физику нашего мира: алгоритмам сложно просчитать реальное трение, упругость материалов и случайные отклонения. Из-за этого роботы, идеально работавшие в виртуальности, становились неуклюжими в реальной жизни.

Как сегодня собирают данные для обучения гуманоидных роботов?

Индустрия делает ставку на оцифровку реальных действий человека. Для этого используют VR-тренажеры, экзоскелеты и системы удаленного управления. Компании напрямую записывают, как люди выполняют бытовые задачи или работают на производственных линиях.

Что такое «Guardrails» и зачем они нужны нейросетям?

«Guardrails» (или «горды») — это программный предохранитель над языковой моделью. Он работает как автоматический цензор: фильтрует вредные запросы на входе, защищая от взломов (промт-инъекций), и блокирует ответы самой нейросети на выходе, если они содержат галлюцинации, дезинформацию или нарушают закон.

В чем заключается главный риск внедрения систем контроля ИИ?

Риск двойной. Во-первых, «горды» не дают стопроцентной защиты от профессиональных хакеров. Во-вторых, возникает проблема цензуры: неясно, кто определяет критерии «неправильных» ответов. Слишком жесткое регулирование может задушить развитие технологий и заморозить инновации.

Глоссарий

| Термин | Определение |

|---|---|

| Guardrails (Горды) | Архитектурная надстройка над системой искусственного интеллекта, предназначенная для фильтрации входящих запросов и исходящих ответов с целью обеспечения безопасности и соблюдения этических норм. |

| Промт-инъекция | Тип кибератаки, при которой злоумышленник целенаправленно манипулирует входными текстовыми данными, чтобы заставить нейросеть обойти встроенные ограничения и выполнить несанкционированное действие. |

| Галлюцинация ИИ | Специфическая ошибка в работе языковой модели, при которой алгоритм генерирует грамматически правильный и правдоподобный, но фактически неверный или полностью выдуманный ответ. |

| Гуманоидный робот | Робототехническое устройство, чья конструкция, механика движений и способы взаимодействия с окружающей средой имитируют физиологию человеческого тела. |

| Технологический суверенитет | Способность государства или корпорации самостоятельно обеспечивать полный цикл разработки и внедрения критически важных технологий без критической зависимости от внешних поставщиков. |