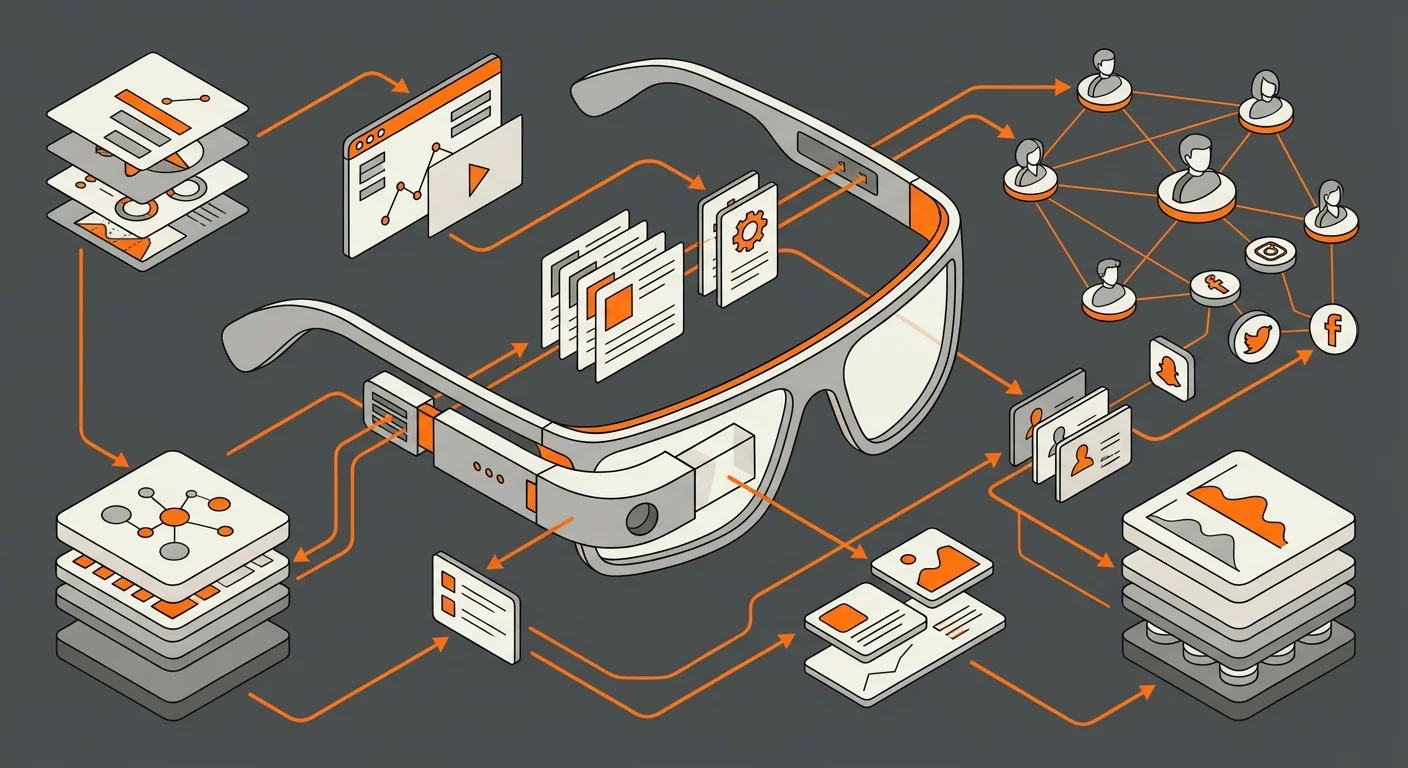

Представьте: вы идете по улице, а умные очки случайного прохожего уже нашли ваш профиль в сети. В марте 2014 года это звучало как завязка киберпанка. Пока медиа бурно обсуждали покупку Oculus VR Марком Цукербергом, настоящая революция разворачивалась вдали от камер — в гудящих серверных. На неделе 26 марта глубокое обучение окончательно вырвалось из университетских лабораторий. Нейросети начали менять реальные сервисы, которыми мы пользуемся каждый день.

Свежий выпуск рассылки AI Week in Review 26.03.14. [Substack], опубликованный всего 20 часов назад, проводит прямую линию между прошлым и настоящим. Автор разбирает недавние релизы: Perplexity Computer, Nemotron 3 Super, Gemini Embedding 2, Claude generative visualization и платформу Interact. Вся эта генеративная магия опирается на архитектурный сдвиг двенадцатилетней давности. Для машинных вычислений это был скачок, сопоставимый с переходом от кнопочных телефонов к сенсорным.

- Представьте: вы идете по улице, а умные очки случайного прохожего уже нашли ваш профиль в сети.

- Свежий выпуск рассылки AI Week in Review 26.03.14.

- Долгое время компьютерное зрение развивалось плавно.

Конец классического зрения и триумф DeepFace

Долгое время компьютерное зрение развивалось плавно. Но именно тогда глубокое обучение впервые всухую обыграло классические методы. Главным потрясением индустрии стал алгоритм DeepFace от инженеров Facebook. Новая система научилась распознавать лица с точностью 97,25 процента. Машина практически сравнялась в зоркости с человеческим глазом.

Топливом для алгоритма стали четыре миллиона фотографий реальных пользователей. Соцсети научились автоматически отмечать людей на снимках. Поиск по картинкам стал таким же предсказуемым, как текстовый запрос в браузере. Нейросеть легко находила старые кадры, даже если человек не был на них подписан. Сторонним разработчикам пришлось экстренно подстраиваться под новые стандарты.

Людям пришлось болезненно привыкать к потере анонимности в толпе. Смартфоны превратились в портативные центры сбора данных. Подобно тому, как современные образовательные ИИ-помощники анализируют паттерны студентов, устройства 2014 года начали непрерывно оцифровывать физическую реальность.

Гонка корпораций: скупка стартапов и талантов

Оцифровка реальности требовала новых ресурсов, и технологические гиганты начали агрессивно скупать независимые ИИ-стартапы. В первом квартале 2014 года инвестиции в отрасль взлетели. Венчурный капитал резко сместил фокус с мобильных приложений на искусственный интеллект. Команда из трех человек могла продаться за миллионы долларов только благодаря удачному алгоритму распознавания.

Google углубила интеграцию лондонского стартапа DeepMind, купленного в январе. Microsoft готовила к запуску голосового помощника Cortana для Windows Phone. Кадровая монополия IT-гигантов ударила по независимым университетам — им стало не хватать талантов. Компании без доступа к большим данным стремительно выбывали из гонки. Сегодня мы видим пик этого тренда в противостоянии крупнейших ИИ-корпораций за доминирование на рынке.

Аналитики опасались, что скупка стартапов убьет независимые исследования. Практика показала иное. Консолидация ресурсов ускорила коммерческий запуск продуктов, но навсегда изменила ландшафт открытой науки.

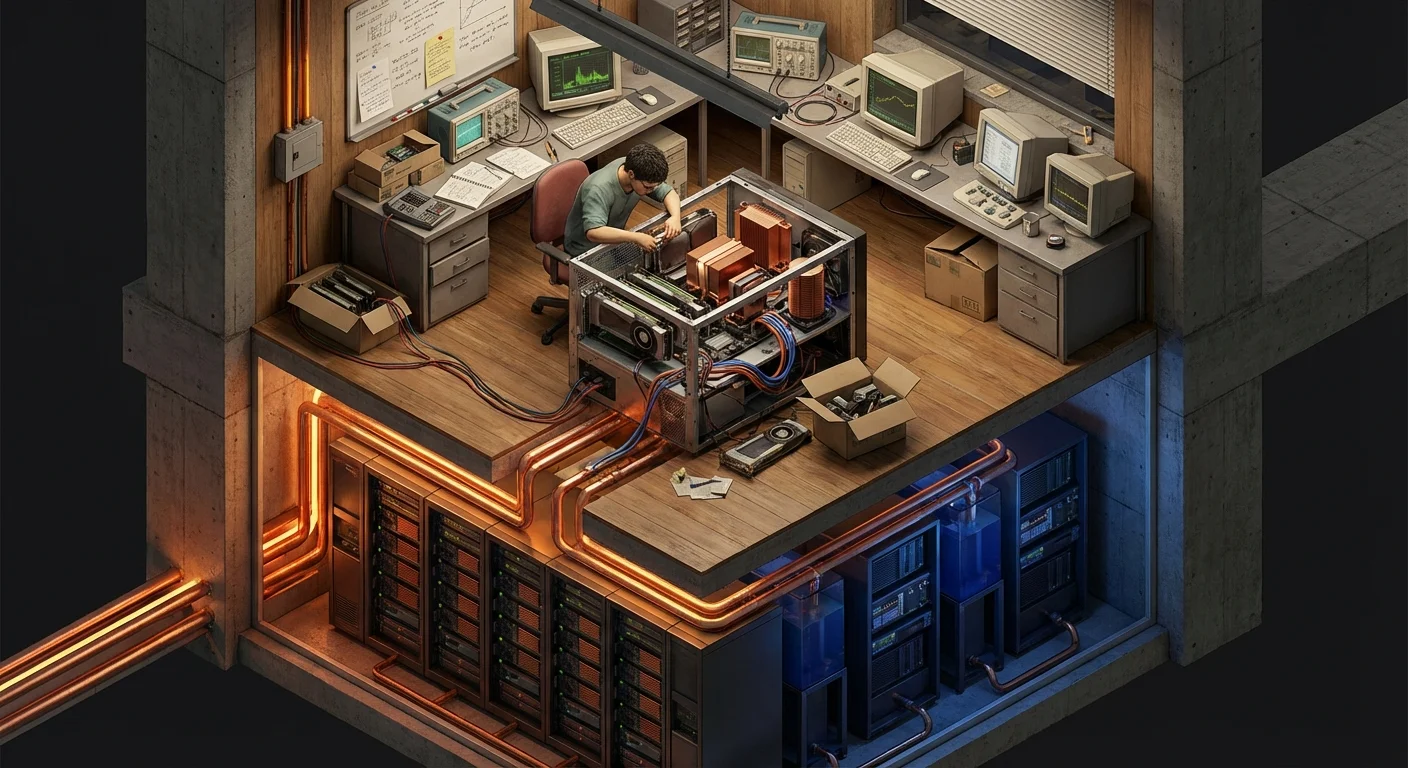

Цена прогресса: черные ящики и энергозатраты

Быстрый запуск продуктов имел свою цену. Алгоритмы 2014 года требовали огромных вычислительных мощностей. Для ускорения обучения нейросети начали массово использовать графические процессоры. Типичная картина того времени: студент тренирует локальную модель на домашнем ПК с мощной игровой видеокартой.

python train_deepface_model.py --use-gpu=True --batch-size=128 --dataset=faces_4M.db --epochs=50Тренировка больших моделей сжигала мегаватты электричества и требовала промышленного охлаждения серверов. При этом системы глубокого обучения оставались непрозрачным «черным ящиком» даже для своих создателей. Исследователи жаловались на острую нехватку размеченных данных. Без ручной сортировки алгоритмы выдавали совершенно абсурдные результаты.

Машинный перевод все еще опирался на статистику и часто ошибался. Голосовые интерфейсы спотыкались о региональные акценты и фоновый шум. Зато мобильные ассистенты начали лучше понимать контекст. Телефон уже мог напомнить купить молоко, отследив по геолокации, что вы подошли к супермаркету.

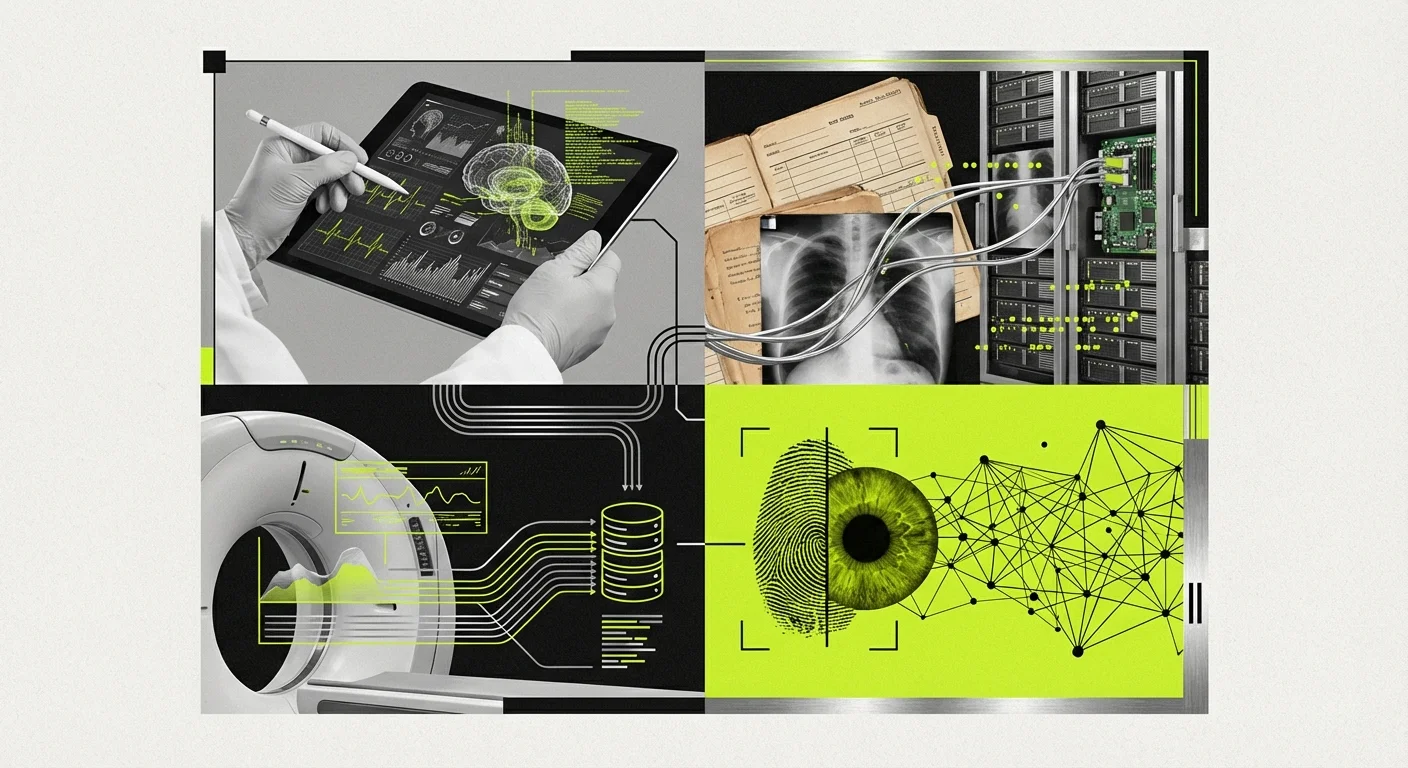

Медицина и биометрия: конец приватности

Пока смартфоны осваивали геолокацию, корпоративный ИИ шел в более сложные сферы. IBM активно внедряла когнитивную систему Watson в клиники. Врачи тестировали первые прототипы ИИ-помощников для разбора запутанных медкарт. Доктор загружал симптомы в Watson и мгновенно получал список редких диагнозов. Заменит ли машина живого диагноста? Споры об этом шли ожесточенные. Как и современные ИИ-ассистенты поддержки, ранние системы искали скрытые паттерны в массивах данных, неподъемных для человека.

В коммерческом секторе рекламодатели получили пугающе точный таргетинг по лицам. Камера в магазине узнавала покупателя на входе и предлагала персональную скидку. Одновременно службы безопасности обзавелись дешевым инструментом для массовой слежки. Камеры в аэропортах научились автоматически вычислять подозреваемых в плотном потоке людей.

Законодательство оказалось не готово к сбору биометрии частными компаниями. Инженеры ломали голову, как защитить камеры от масок и преднамеренного обмана. Сегодня даже безобидные генераторы кулинарных рецептов работают в строгих правовых рамках. В 2014 году этих рамок просто не существовало.

Отголоски 2014 года в современных реалиях

Текущий бум нейросетей может показаться инвесторским пузырем. Но его фундамент прочно залили более десяти лет назад. Было ли общество готово к биометрическому контролю на улицах? Очевидно, нет. Смогут ли люди запретить алгоритмам сканировать личные фото? Этот бой за приватность идет до сих пор.

События конца марта 2014 года доказали: точность алгоритмов будет расти. Глубокое обучение навсегда покинуло лаборатории. Современные генеративные модели лишь масштабируют принципы, заложенные в эпоху первых успехов DeepFace и DeepMind.

Если хотите углубиться дальше на Dinkin, откройте FitCoach для похудения и тренировок. Эти материалы логично продолжают тему статьи и дают следующий практический шаг.

FAQ

Почему именно неделя 26 марта 2014 года считается переломной?

В этот период сошлись три фактора: Facebook показал алгоритм DeepFace с точностью 97,25%, взлетели инвестиции в ИИ-стартапы, а глубокое обучение на практике обошло классическое компьютерное зрение.

В чем заключалась главная проблема алгоритмов того времени?

Нейросети оставались непрозрачным «черным ящиком». Они требовали огромных затрат на электричество и охлаждение, работая на игровых видеокартах. Точность распознавания сильно зависела от освещения.

Как изменился подход инвесторов в первом квартале 2014 года?

Венчурный капитал резко переключился с мобильных приложений на искусственный интеллект. IT-гиганты начали массово скупать независимые команды, взвинтив цены на разработчиков.

Что происходило с внедрением ИИ в медицину?

IBM начала внедрять систему Watson в клиники. Врачи получили первые прототипы ИИ-помощников: алгоритм анализировал симптомы из медкарт и мгновенно выдавал список редких диагнозов.

Как алгоритмы повлияли на приватность обычных пользователей?

Соцсети начали автоматически отмечать людей на фото. Рекламодатели освоили таргетинг по лицам, а камеры научились вычислять людей в толпе. При этом законов о сборе биометрии еще не было.

Глоссарий

| Термин | Определение |

|---|---|

| DeepFace | Алгоритм распознавания лиц от Facebook (2014 год). Достиг точности 97,25% благодаря глубокому обучению. |

| Глубокое обучение (Deep Learning) | Класс методов машинного обучения на базе искусственных нейросетей с множеством скрытых слоев. |

| Когнитивная система Watson | Суперкомпьютер IBM с искусственным интеллектом. Понимает запросы на естественном языке и находит ответы в больших массивах данных. |

| Биометрический вектор | Математическое представление уникальных черт человека (например, геометрии лица). Используется для идентификации. |

| Черный ящик (Black Box) | Проблема непрозрачности нейросетей. Разработчики видят входящие данные и результат, но не могут точно объяснить внутреннюю логику алгоритма. |