Docker навсегда избавил нас от ручной сборки серверов. Сейчас индустрия переживает похожий сдвиг: локальное тестирование нейросетей уступает место облачным песочницам с готовыми датасетами. Разработчики больше не просто пишут код — они стали операторами ИИ-экспериментов. Отчет SlashData подтверждает: трансформация разработки завершена. Платформы уровня Google Labs превратились в главные полигоны для обкатки гипотез. Концепция AI Experiment Hubs определяет архитектуру, бюджеты и рутину продуктовых команд в Q1 2026.

На бумаге облачные песочницы радикально ускоряют релизы. На практике настройка хаба часто отнимает больше времени, чем написание бизнес-логики. Да, благодаря AI-платформам новичок разворачивает проект за пару минут. Но цена этой скорости — тотальная зависимость от внешней инфраструктуры. Современная среда разработки мертва без стабильного и быстрого канала до GPU-кластера.

- Docker навсегда избавил нас от ручной сборки серверов.

- На бумаге облачные песочницы радикально ускоряют релизы.

- Бизнес-логика переезжает из жесткого кода в настраиваемые промпты.

Архитектура и маршрутизация: конец монолитных привязок

Бизнес-логика переезжает из жесткого кода в настраиваемые промпты. Архитектуру приходится перестраивать с нуля. Теперь приложения строятся вокруг горячей замены языковой модели. Поменяли температуру генерации — и строгий бот мгновенно стал креативным помощником.

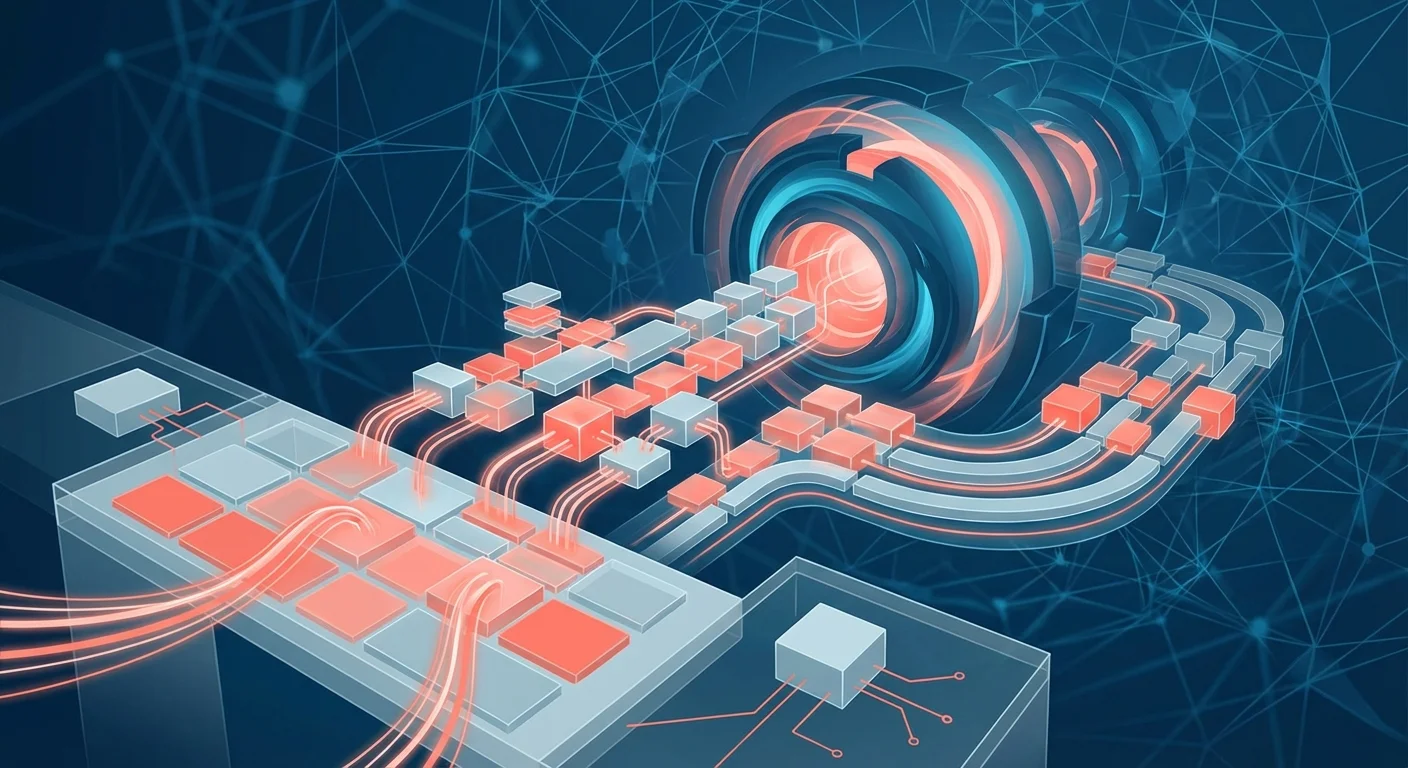

Тренд 1: Интеграция LLM-маршрутизаторов стала стандартом для корпоративных AI-хабов в 2026 году. Команды больше не хардкодят вызовы к конкретному API. Маршрутизатор сам раскидывает запросы между моделями, оценивая нагрузку и тип задачи. Итог: меньше сбоев, ниже затраты.

Тренд 9: Крупные вендоры разделили среды для обучения и среды для инференс-экспериментов. Смешивать эти процессы стало слишком дорого. Инференс-песочницы получили свои инструменты. Теперь гипотезы проверяются быстро и без риска сломать веса базовой модели.

Тренд 12: Открытые модели теперь тестируются в хабах одновременно с проприетарными через единый API. Грань между опенсорсом и закрытым ПО стирается на уровне интерфейсов. Тренды открытых репозиториев доказывают: унификация API позволяет стравливать любые модели в равных условиях.

infrastructure_as_code:

ai_hub:

router: active

primary_model: proprietary_v4

fallback_model: open_weights_v2

declarative_params:

temperature: 0.4

context_window_limit: 32kИнфраструктура как код теперь включает параметры нейросетей. В конфигах лежат не только порты, но и лимиты токенов, системные промпты, правила фоллбэка. Контекстное окно стало таким же ограниченным ресурсом, как оперативная память. Разработчикам приходится учиться им управлять.

Эволюция отладки: графы мыслей вместо брейкпоинтов

Вместе с архитектурой изменился и поиск ошибок. Отладка превратилась в анализ логов вероятностей и весов токенов. Забудьте про классический дебаггер. Раньше программист искал опечатку в цикле. Теперь он смотрит на визуальный граф мыслей ИИ-модели, пытаясь понять, где нейросеть свернула на неверный семантический путь.

Тренд 5: В Q1 2026 GitHub Copilot Workspace полностью интегрировал визуальные графы экспериментов. Визуализация стала критичной для понимания нелинейного генеративного ИИ. Разработчики наглядно видят ветвления диалогов и точки старта галлюцинаций.

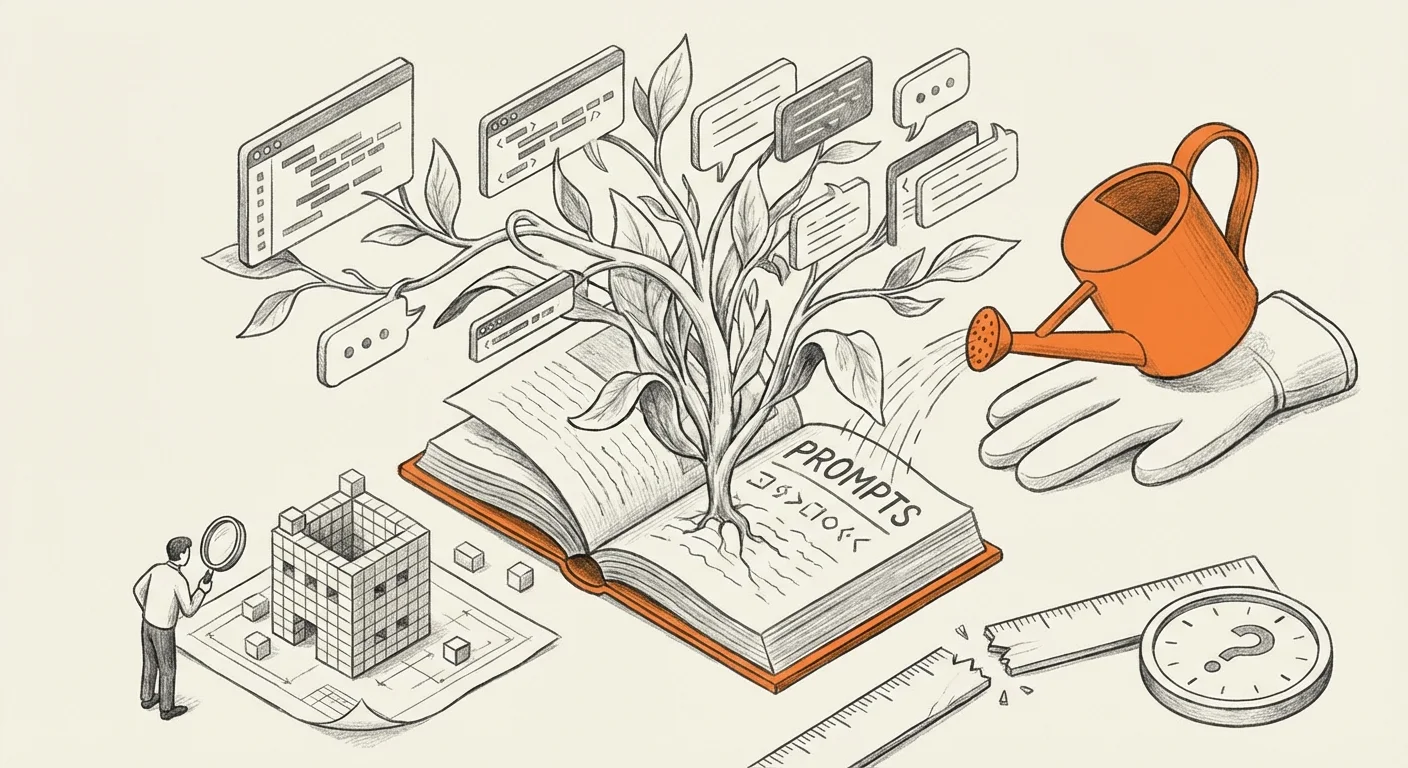

Тренд 13: Версионирование промптов окончательно отделилось от версионирования исходного кода. Промпты живут своей жизнью. Замена одного слова в системном сообщении ломает тесты, хотя исходный код не менялся. Чтобы управлять этим хаосом, команды внедряют профильных ассистентов. Они отслеживают эффективность каждого текстового запроса.

В хабе LangSmith путь каждого токена отслеживается как посылка в логистике. Петля обратной связи для модели стала важнее оптимизации SQL-запросов. Без корректировки в реальном времени приложение стремительно деградирует.

Мультиагентные симуляции и отказ от моков

Деградирующее приложение нужно тестировать, но старые методы здесь не работают. Вместо написания mock-объектов команды запускают агентов. Они симулируют поведение базы данных или стороннего API. Тестирование становится максимально реалистичным, но сжигает огромные вычислительные мощности.

Тренд 2: Платформы вроде Hugging Face Spaces ввели нативную поддержку мультиагентных сред. Агенты общаются друг с другом без участия человека. Типичный сценарий: ИИ-тестировщик находит баг, а ИИ-разработчик тут же пишет патч прямо в хабе.

Тренд 3: Использование синтетических данных для тестирования в хабах выросло до восьмидесяти процентов. Сбор реальных логов уперся в законы о приватности. Синтетика решает проблему, позволяя сгенерировать любые крайние случаи.

Тренд 11: Платформы начали предлагать встроенные симуляторы пользовательского поведения для оценки ИИ. Они имитируют непредсказуемость живых людей. Система проверяется на устойчивость к странным или откровенно вредоносным запросам.

Инфраструктура, метрики и цена неудач

Такие симуляции стоят денег, и экономика разработки переворачивается. Содержание инфраструктуры для ИИ-экспериментов дорожает. Команды вынуждены выделять отдельные бюджеты исключительно на неудачные генерации в песочницах.

Тренд 6: Стоимость API-вызовов для тестирования снизилась, но объем тестов вырос экспоненциально. Удешевление одного токена не спасает. Мультиагентные системы генерируют миллионы токенов в минуту, поэтому общие чеки только растут.

Тренд 4: Появились стандартизированные метрики галлюцинаций для автоматической отбраковки моделей на этапе CI/CD. Если процент выдуманных фактов превышает лимит, сборка падает. Тестировщики массово переквалифицируются в валидаторов семантического вывода.

Тренд 8: Внедрение автоматического A/B тестирования промптов стало базовой функцией любого AI-хаба. Система сама прогоняет сотни инструкций на синтетических датасетах. В работу идет вариант с наименьшим процентом отказов.

Тренд 14: Инструменты мониторинга углеродного следа ИИ-экспериментов стали обязательными в Европе. Жесткие экологические нормы заставляют европейские стартапы оптимизировать не только скорость песочниц, но и их энергопотребление.

Новые роли и смена парадигмы обучения

Изменение метрик и процессов напрямую бьет по людям. Профессия программиста трансформируется. Джуниоры тратят больше времени на подбор промпта, чем на написание алгоритма. Код-ревью теперь включает проверку диалогов с ИИ-агентом. Сеньоры смотрят не только на финальный коммит. Им важно, как именно младший коллега ставил задачу нейросети.

Тренд 7: Популярность RAG-песочниц превысила спрос на классические базы данных векторного типа. Разработчикам нужны готовые среды. Там генерация сразу дополняется поиском, и не нужно вручную настраивать эмбеддинги или индексы.

Тренд 10: Появился класс разработчиков, специализирующихся исключительно на оркестрации AI-хабов. Они не пишут продуктовую логику. Их фокус — настройка пайплайнов, управление бюджетами на токены и оптимизация маршрутизации.

Образование подстраивается под новые реалии. Инструменты для обучения помогают новичкам быстрее вникнуть в концепцию вероятностного программирования.

Скрытые угрозы: вендор-лок и паралич выбора

Но за красивым фасадом вероятностного программирования скрываются серьезные риски. Экосистема полна подводных камней. Привязка к одному AI-хабу грозит жестким вендор-локом. Если обновление весов закрытой модели ломает логику приложения, у команды часто нет плана Б. Остается только откатиться на старую версию — если вендор вообще дает такую возможность.

На бумаге автотесты промптов гарантируют качество. В реальности они пропускают тонкие логические ошибки. Галлюцинации могут незаметно уйти в продакшен, если валидаторы упустят контекст.

Переизбыток инструментов вызывает паралич выбора. Стандарты меняются каждый месяц. Законы о данных тормозят европейские песочницы. Многие заявленные фичи Q1 2026 под нагрузкой работают нестабильно. А высокие цены на вычисления отрезают мелкие инди-студии от полноценных AI-хабов.

Безопасность на уровне песочниц: Red Teaming как рутина

Вариативность моделей создает не только проблемы с тестированием, но и новые векторы атак. Уязвимости нулевого дня перекочевали из бинарников в естественный язык. Промпт-инъекции и джейлбрейки стали аналогом SQL-инъекций из нулевых. Разница в том, что дыру в базе закрывают патчем. А отучить языковую модель от социальной инженерии — задача с нечеткой логикой. Поэтому AI-хабы встроили автоматический Red Teaming прямо в процесс сборки.

Раньше безопасники приходили на аудит готового релиза. Теперь атаки идут непрерывно внутри песочницы. Агенты-взломщики бомбардируют систему тысячами вредоносных промптов. Они пытаются вытащить API-ключи, обойти этические фильтры или выполнить чужой код. Конфигурация уходит в деплой, только если выдерживает этот стресс-тест.

Главным вызовом стали косвенные инъекции (Indirect Prompt Injection). Модель может поймать вредоносный промпт из безобидного PDF или веб-страницы. Хабы предлагают изолировать контекст. Внешние данные обрабатывает «глупая» модель с жесткими лимитами. Финальный ответ формирует «умная» модель, у которой нет прямого доступа к сырому тексту.

Гибридная маршрутизация: ренессанс локальных вычислений

Безопасность требует ресурсов, а тотальный уход в облака столкнулся с экономической реальностью. Счета за инференс тяжелых моделей заставили бизнес пересмотреть архитектуру. Ответом стали гибридные AI-хабы. Они умеют бесшовно жонглировать облачными кластерами и локальным железом пользователя.

Нейронные сопроцессоры (NPU) стали нормой, а стандарт WebGPU шагнул вперед. Теперь браузеры запускают квантованные модели без задержек. Умный маршрутизатор сначала оценивает сложность задачи. Базовая генерация интерфейса или автодополнение текста идут прямо на устройстве. Если нужен глубокий анализ — хаб отправляет запрос в облако к тяжеловесным LLM.

Developer Experience (DX): смерть традиционного контекста

Сложность архитектуры меняет и сам процесс написания кода. Рабочая среда вышла за пределы открытого файла в IDE. Главная проблема разработчика — не написать функцию, а скормить нейросети правильный контекст. Если модель не знает об утилите в соседней папке, она изобретет велосипед. Если отдать ей весь репозиторий — контекстное окно переполнится, а качество генерации рухнет.

AI-хабы стали интеллектуальными кураторами контекста. Через семантический поиск по кодовой базе они собирают ровно те фрагменты, которые нужны агенту прямо сейчас. Разработчик контролирует процесс визуально: видит подтянутые файлы и вручную отсекает лишнее, снижая информационный шум.

- Контекст как артефакт: Набор файлов, с которым удалось сгенерировать сложную фичу, сохраняется как шаблон. Им делятся с коллегами, чтобы чужой агент сразу получил нужный контекст.

- Семантический Diff: При слиянии веток хабы анализируют не только измененные строки. Они просчитывают, как эти правки повлияют на поведение зависимых ИИ-агентов.

Легаси-код и агенты-археологи

Новые подходы к контексту оказались спасением для старых проектов. Корпорации не могут переписать монолиты двадцатилетней давности по щелчку пальцев. Банки и госсектор зависят от миллионов строк на Java, C# и COBOL. В Q1 2026 AI-хабы стали мостом между устаревшей инфраструктурой и генеративным ИИ.

Вместо рискованного рефакторинга команды запускают в песочницах «агентов-археологов». Они не трогают старый код. Они изучают его поведение, читают пыльную документацию и генерируют современные API-обертки. Хаб безопасно натравливает агентов на копии старых баз, где те восстанавливают бизнес-логику по паттернам движения данных.

Появилась новая метрика — индекс понимаемости кода машиной (Machine Readability Index). Код по строгим стандартам SOLID легко читается LLM. А вот хитрые оптимизации из нулевых ставят нейросети в тупик. Разработчики проводят «обратный рефакторинг»: делают легаси-системы более многословными и явными, чтобы агентам было проще с ними работать.

Резюме: адаптация или маргинализация

Эпоха ручного управления кодом уходит в прошлое. Экосистема AI Experiment Hubs сформировала новый класс инженерных задач. Написание чистого кода уступило место проектированию устойчивых вероятностных систем. Команды, игнорирующие облачные песочницы ради ручного дебаггинга, стремительно теряют скорость. Но и ранние последователи платят свою цену: они сталкиваются с непредсказуемыми расходами и переучивают целые отделы.

Успех продуктовой разработки измеряется не закрытыми тикетами, а качеством пайплайнов обратной связи. Чем быстрее хаб находит галлюцинацию, изолирует уязвимость и переключает модель, тем выше шансы компании выжить в непрерывной ИИ-гонке.

FAQ

Кто несет ответственность, если мультиагентная система в хабе сгенерирует уязвимый код?

Ответственность остается на команде и операторах AI-хаба. Автоматизация не отменяет ручную и семантическую валидацию. Ревью кода теперь включает проверку истории генераций — так отслеживают логику решений агента.

Не приведет ли зависимость от AI-хабов к потере базовых навыков программирования?

Риск есть. Джуниоры уже уделяют промптам больше внимания, чем алгоритмам. Но фокус просто смещается: от синтаксиса к системной архитектуре, оркестрации и пониманию вероятностных моделей. Базовые навыки не исчезают, а эволюционируют.

Как защитить коммерческую тайну, если все эксперименты проходят в облачных песочницах вендоров?

Компании разворачивают корпоративные AI-хабы с изолированными средами и жесткими SLA. LLM-маршрутизаторы фильтруют чувствительные данные до отправки во внешнее облако. Реальная информация заменяется синтетикой.

Действительно ли синтетические данные адекватно отражают поведение реальных пользователей?

Синтетика покрывает до восьмидесяти процентов сценариев, включая редкие граничные случаи. Имитировать непредсказуемость живых людей сложнее. Чтобы закрыть этот пробел, платформы внедряют встроенные симуляторы поведения.

Почему метрики успешности ИИ-экспериментов до сих пор так легко подделать?

Ответы языковых моделей вариативны. Систему, которая каждый раз отвечает по-разному, трудно загнать в рамки классических тестов. Автоматика часто ищет лишь формальные совпадения текста и пропускает тонкие логические сбои.

Глоссарий

| Термин | Определение |

|---|---|

| AI Experiment Hub | Облачная песочница и рабочее пространство. Объединяет инструменты оркестрации, тестирования и мониторинга нейросетей. |

| LLM-маршрутизатор | Инфраструктурный компонент. Динамически распределяет запросы между языковыми моделями, учитывая стоимость, скорость и доступность. |

| Мультиагентная среда | Виртуальное пространство. В нем несколько ИИ-агентов с разными ролями (например, разработчик и тестировщик) взаимодействуют автономно. |

| Валидатор семантического вывода | Новая специализация QA-инженеров. Фокус — на проверке смысловой корректности и логики ответов генеративных моделей. |

| RAG-песочница | Изолированная среда для тестирования генерации с дополненной выборкой (Retrieval-Augmented Generation). Не требует ручной настройки баз данных. |

| Граф мыслей (Thought Graph) | Визуализация принятия решений нейросетью. Показывает ветвления логики и вероятности выбора токенов при генерации. |